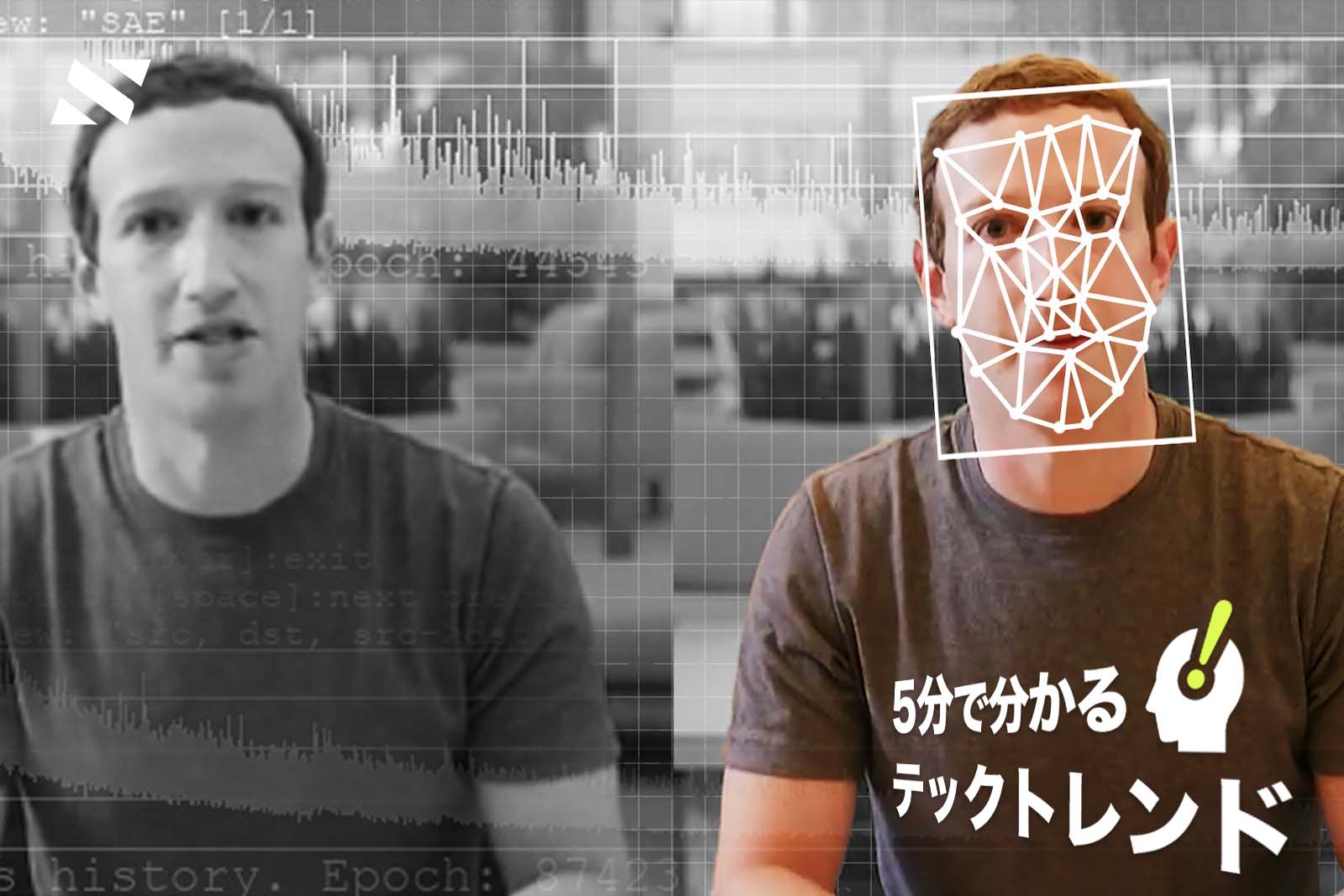

AI技術を使い、画像や動画に登場する人物の顔を別人のものと差し替える、フェイクコンテンツの「ディープフェイク」。2019年にはFacebook・CEOのマーク・ザッカーバーグ氏が「1人の男が数十億人から盗んだデータを支配することを想像してください」と発言しているかのように見せたディープフェイク動画が話題となった。

エンターテインメントなどの領域で利用が期待されていたが、現状は悪用で注目を集めるケースが増えている。日本でも2020年、女性芸能人がアダルトビデオに出演しているかのように見せかけるディープフェイク動画を作成した元大学生の男が逮捕された。2021年9月には判決公判が東京地裁であり、楡井英夫裁判長は男に対し、懲役2年(執行猶予3年)、罰金100万円の有罪判決を言い渡した。

もちろん、エンターテインメント目的の利用も進んでいる。最近ではディープフェイクを活用した顔交換アプリ「Reface」を使って、自分の顔と著名人の顔を入れ替えた動画を作り、SNSに投稿して楽しむユーザーも増えてきた。

My long lost audition for Lord of the Rings. I thought I nailed it. You decide. pic.twitter.com/4ITEpLK0gD

— Bruce Campbell (@GroovyBruce) May 31, 2021

ディープフェイクの悪用の実態やその対策、そして今後の有効活用やさらなる可能性について、AIを活用した“フェイク映像“カメラアプリ「xpression camera」などを展開するEmbodyMeの代表取締役・吉田一星氏に聞いた。

──ディープフェイクとはどのような技術を活用した、どのようなコンテンツを指すのでしょうか。