DeepSeekはオープンソース。誰でもローカルで動かせて、商業利用もしやすい

DeepSeekはオープンソースで提供されているのも大きな特徴だ。DeepSeek R1もMITライセンスのもとで公開されており、これにより開発者は自由に使用、改変、再配布が行える。商用利用を含む幅広い用途に対応しており、研究目的だけでなく、商業プロジェクトでも利用できる。アウトプットをビジネスで使う、というだけでなく、企業や開発者がDeepSeek R1を使って製品やサービスを開発することができるのだ。

一部の生成AI(LLM)は、軽量化することで、パソコンやスマートフォンで動かすことができるようになる。これを蒸留(Distillation)と呼ぶ。DeepSeekでは、DeepSeek-R1を蒸留したコンパクトなAIモデルも提供しているので、これを利用すればローカルの環境でDeepSeekを実行できるようになる。元のモデルの性能を保ちながら、リソースが限られた環境でも実行できるので、個人や小規模な開発者にとって利用しやすくなるメリットがある。

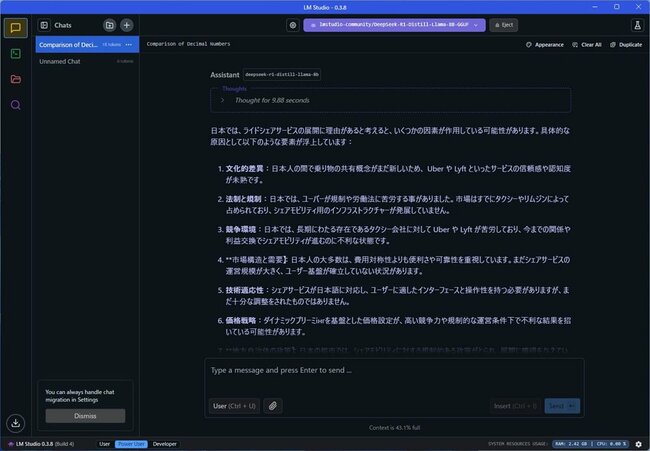

実際に「LM Studio」を使って、「DeepSeek-R1-Distill-Llama-8B」をダウンロードし、自分のパソコンで動かしてみた。ちなみに、モデルのサイズは4.92GBだった。

日本語がちょっと弱いものの、コンパクトな8Bモデルでもそこそこの性能を持っている。このAIが無料で、ローカルで動作するというのは驚きだ。すぐに他言語が回答に混じってくるので、今すぐにChatGPTから乗り換えよう、というレベルではないものの、ちょっと生成AIのあり方が大きく変わるような気もする。

ちなみに、蒸留モデルをローカルで動かす場合は、DeepSeek R1ではできなかったこと(官能小説を書かせたり、天安門事件などの政治的なキーワードについて解説させたり)が成功することもある。