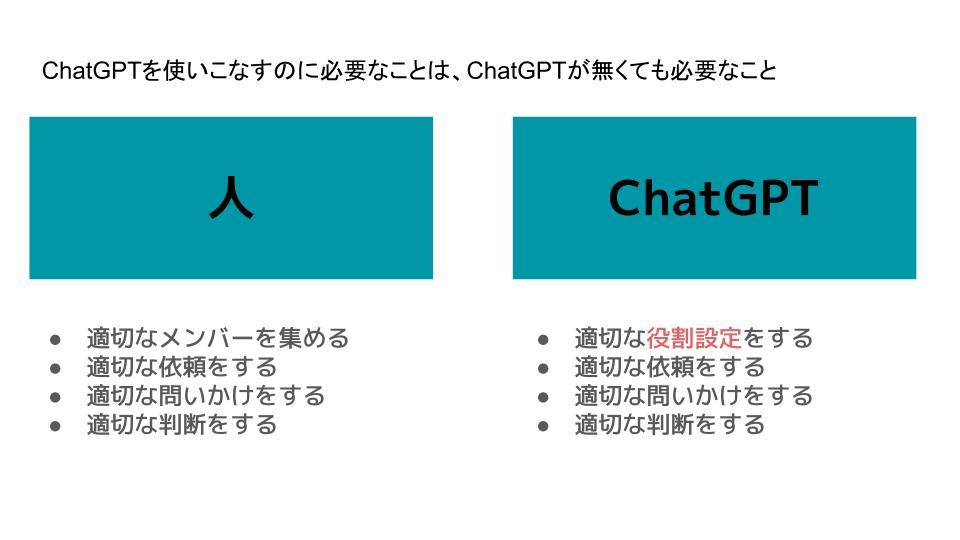

人(リーダー)が誰かとの対話やチームの中で創造的な作業を成功させるには、まず適切なメンバーを集め、「こういう立場、こういう目標で進めてほしい」と依頼するでしょう。チームに相談して面白い回答が返ってきたら、適切な判断によってそれを深掘りしていくことで、当初思いもよらなかった新しい考えにたどり着きます。

実はChatGPTなどの生成AIを使いこなすときにも、やるべきことは同じです。AIに立場を与え、役割設定をした上で、適切な依頼、問いかけ、判断をする。これを繰り返せば、生成AIをチームの一員とした発明やイノベーションが可能になるはずです。

人と生成AIが結果を出すために必要なことは似ている

人と生成AIが結果を出すために必要なことは似ている拡大画像表示

したがって、AIが単独で創造的作業をすることは今は難しいと思いますが、生成AIの創造的な限界の課題については、使う側の人間次第でクリアできるのではないでしょうか。

生成AIがCO2排出量に影響

倫理面ではEUを中心に規制強化の動きも

生成AIの「倫理的な課題」に関しては、世界のさまざまな専門家や活動家が利用に規制を設けるべきだと発言しています。6月14日にはEUの立法議会で「AIアクト」と呼ぶ規制法案について、生成AIに対する規制も盛り込むべきだとする修正案が賛成多数で採択されました。

この修正案は、AIを使って作られたコンテンツはそれを明示すること、著作権で保護されたデータをAIの学習データに利用した場合はそれを公表することなど、透明性を高めることを義務化する内容となっています。

一方で、こうした規制に反対する人もいます。彼らは「規制ではなく、AIを監視・監督することでリスク回避できるのではないか」と考えています。

最後の「エネルギー消費」の課題も、見逃されがちですが大きな問題です。スタンフォード大学のAIに関する年次レポート「AI Index Report 2023」では「AIは環境を助けるものでもあり、害をなすものでもある」として、AIの利用で膨大なCO2が排出されることを指摘し、今後これが大きな問題になっていく可能性があると報告されています。